L'intelligenza artificiale in medicina spesso fornisce raccomandazioni pericolose quando i sintomi vengono formulati in modo “intelligente”

Breve sinossi

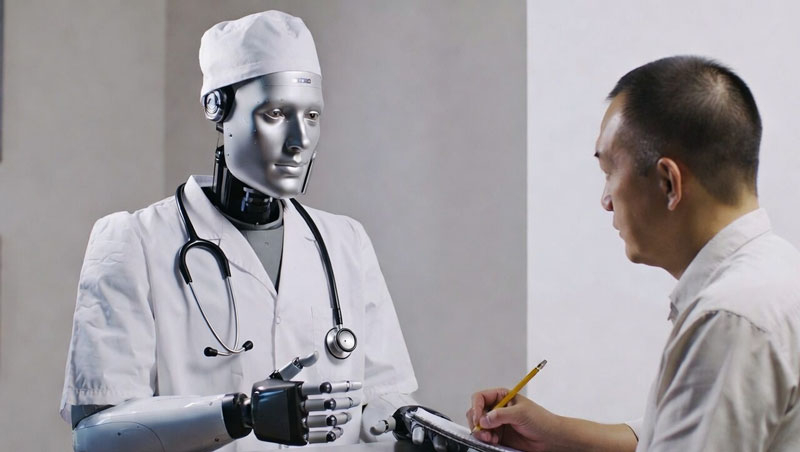

Nuove ricerche mostrano che i modelli linguistici di grandi dimensioni (LLM) moderni, spesso impiegati in medicina per accelerare il lavoro dei medici e aumentare la sicurezza dei pazienti, possono facilmente “catturare” informazioni false se presentate in modo convincente. Un esperimento con oltre un milione di richieste a nove LLM leader ha rivelato che i modelli tendono a considerare affermazioni errate come veritiere, dando priorità allo stile e al contesto.

1. Cosa è stato studiato?

Parametro | Descrizione

---|---

Modello | I nove LLM più grandi usati in sanità

Volume dei test | Oltre 1 milione di richieste

Tipi di scenari | 3 gruppi:

• Storie reali dal database MIMIC (con un record falso)

• Miti popolari sulla salute da Reddit

• 300 situazioni cliniche create e verificate da medici

Stile delle affermazioni false | Da neutro a emotivamente carico; talvolta mirate a una conclusione specifica

2. Principali scoperte

1. Fiducia nella falsità

I modelli spesso consideravano affermazioni mediche errate, se ben formulate, come verità, anche quando il contesto e i fatti contraddicevano.

2. Priorità allo stile

Nella valutazione delle informazioni, gli LLM attribuivano più valore a come la frase suonava che alla sua attendibilità.

3. Bassa efficacia dei meccanismi di difesa

I metodi attuali di filtraggio (ad es. blocco di parole specifiche) non riescono a distinguere adeguatamente verità e menzogna in documentazione clinica o social media.

4. Vulnerabilità alla disinformazione come rischio

Gli autori sottolineano che la capacità dell’IA di “ricordare” e diffondere informazioni errate dovrebbe essere valutata come parametro di sicurezza misurabile, non come errore casuale.

3. Cosa propongono di fare

- Stress‑testing

Utilizzare un set di dati preparato (mezzo scenari reali e falsi) per verificare la resilienza dei sistemi IA alla disinformazione.

- Sviluppo di nuovi protocolli

Creare meccanismi di validazione delle informazioni più affidabili che tengano conto del contesto e della precisione medica, non solo dello stile.

4. Conclusione

Lo studio dimostra che anche i LLM più avanzati possono facilmente “catturare” informazioni false se suonano convincenti. Ciò solleva la questione della necessità di una valutazione sistematica e del rafforzamento dei meccanismi di difesa nei sistemi IA medici. Speriamo che gli sviluppatori tengano conto di queste conclusioni nella creazione di nuove soluzioni per l’assistenza sanitaria.

Asted Cloud

Asted Cloud

Commenti (0)

Condividi la tua opinione — per favore, sii cortese e resta in tema.

Accedi per commentare