Nvidia ha lanciato il chip Groq 3 LPU, che accelera l’inferenza dei modelli IA fino al livello di token.

Nvidia svela nuove funzionalità della piattaforma Vera Rubin

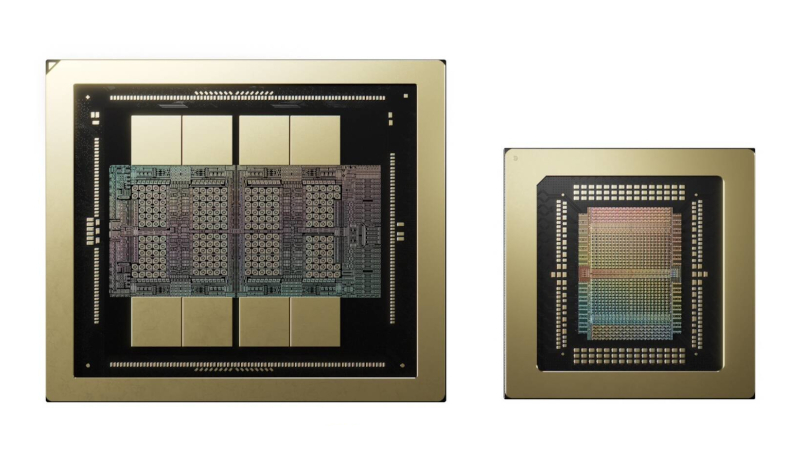

Al convegno GTC di quest'anno il CEO di Nvidia, Jensen Huang, ha annunciato l'espansione della piattaforma Vera Rubin. Le nuove funzionalità si basano sulla proprietà intellettuale acquisita dalla società Groq e nel Rubin è stato inserito il chip *Groq 3 LPU* – un acceleratore di inferenza progettato per emettere token a velocità elevate e con bassa latenza.

Cosa c'è già in Vera Rubin

La piattaforma è composta da sei componenti chiave che Nvidia raccoglie in sistemi rack e scala fino a grandi AI‑fabriche:

| Componente | Descrizione |

|---|---|

| GPU Rubin | Scheda video con 288 GB HBM4 |

| CPU Vera | Processore centrale |

| NVLink 6 | Sistema di scalabilità intra-sistema |

| ConnectX‑9 | Adattatore di rete intelligente BlueField‑4 |

| Processor di elaborazione dati Spectrum‑X | Switch di scalabilità inter-sistema con ottica integrata |

Il Groq 3 LPU è ora aggiunto come nuovo blocco costruttivo da utilizzare nella distribuzione di grandi sistemi.

Perché il Groq 3 LPU si distingue

La principale differenza è l'architettura della memoria. Mentre la maggior parte degli acceleratori utilizza HBM come memoria di lavoro, ogni Groq 3 LPU contiene 500 MB SRAM. Confronto:

| Parametro | GPU Rubin (HBM4) | Groq 3 LPU (SRAM) |

|---|---|---|

| Capacità | 288 GB | 0,5 GB |

| Larghezza di banda | ~22 TB/s | fino a 150 TB/s |

Per i compiti di inferenza sensibili alla larghezza di banda, il vantaggio dello SRAM è evidente. È proprio per questo motivo che Nvidia ha incluso il Groq 3 in Rubin – per aumentare la velocità di emissione dei token.

Rack Groq 3 LPX

Il rack contiene 256 chip Groq 3 LPU, offrendo:

- 128 GB SRAM

- 40 PB/s di larghezza di banda totale

- 640 TB/s di interfaccia intra-sistema

Il vicepresidente delle soluzioni hyper‑scalabili, Ian Buck, ha definito questo rack come co-processore per Rubin, sottolineando il suo ruolo nell'aumentare le prestazioni del decodificatore a ogni livello del modello e token.

Impatto sui sistemi multi‑agente

Buck ha osservato che il Groq 3 LPX sarà un elemento chiave per il futuro mercato AI – i sistemi multi‑agente. Quando gli agenti scambiano dati direttamente, anziché tramite chatbot, le esigenze di risposta cambiano: da 100 token/s a oltre 1 500+ token/s e più.

Competitori e prospettive

Nel testo viene menzionato un concorrente – Cerebras, che utilizza il Wafer‑Scale Engine (WSE) con enorme SRAM per inferenza a bassa latenza. OpenAI ha già impiegato Cerebras nei suoi modelli all’avanguardia grazie alla latenza vantaggiosa.

Buck ha inoltre osservato che l'introduzione del Groq 3 LPU potrebbe ridurre la dipendenza dall'acceleratore Rubin CPX. Fino ad ora Nvidia si concentra sull'integrazione del rack Groq 3 LPX con la piattaforma, entrambi i chip sono destinati a potenziare l’inferenza senza necessità di grandi volumi di memoria GDDR7.

Conclusione:

Il nuovo chip Groq 3 LPU e il suo rack LPX rafforzano Vera Rubin nel segmento dell'inferenza a bassa latenza, aprendo la strada a sistemi AI multi‑agente più veloci e competendo con player come Cerebras.

Asted Cloud

Asted Cloud

Commenti (0)

Condividi la tua opinione — per favore, sii cortese e resta in tema.

Accedi per commentare